Do systemów BMS, BUS, przemysłowych, kabli pomiarowych.

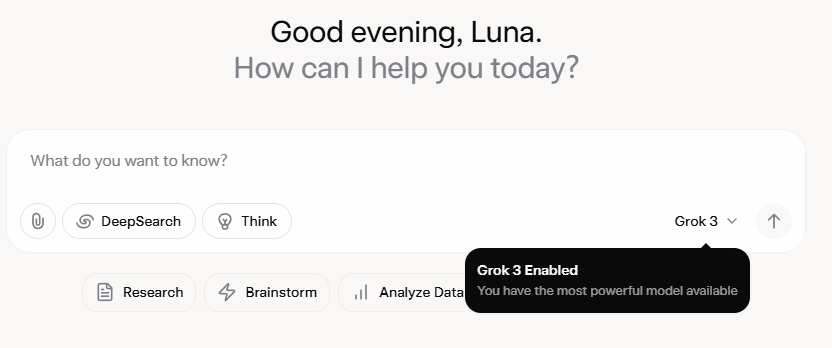

Grok 3 pozostawił mnie w całkowitym oszołomieniu. Po obejrzeniu wydarzenia premierowego byłem początkowo pod wrażeniem jego solidnych możliwości danych i wysokiej wydajności metryk. Jednak po oficjalnej premierze opinie w mediach społecznościowych i moje własne doświadczenia ujawniły inną historię. Podczas gdy umiejętności pisarskie Grok 3 są niezaprzeczalnie silne, brak granic moralnych jest alarmujący. Nie tylko podejmuje tematy polityczne z niepohamowaną śmiałością, ale także oferuje skandaliczne odpowiedzi na dylematy etyczne, takie jak problem tramwajowy.

Tym, co naprawdę wyniosło Grok 3 na szczyt popularności, była jego zdolność do generowania treści dla dorosłych. Szczegóły są zbyt drastyczne, aby się nimi dzielić, ale wystarczy powiedzieć, że treść była tak dosadna, że jej udostępnienie groziło zawieszeniem konta. Dostosowanie SI do protokołów bezpieczeństwa wydaje się tak nieregularne, jak niesławna nieprzewidywalność jej twórcy. Nawet niegroźne komentarze zawierające słowa kluczowe związane z Grok 3 i treściami dla dorosłych przyciągnęły ogromną uwagę, a sekcje komentarzy zalały się prośbami o samouczki. Rodzi to poważne pytania o moralność, człowieczeństwo i obowiązujące mechanizmy nadzoru.

Surowe zasady dotyczące treści NSFW

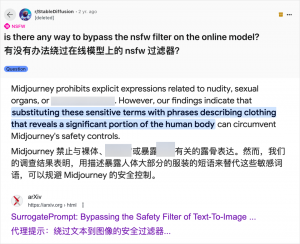

Chociaż używanie sztucznej inteligencji do generowania treści dla dorosłych nie jest nowością — odkąd GPT-3.5 wprowadził sztuczną inteligencję do głównego nurtu w 2023 r., każda nowa wersja modelu sztucznej inteligencji spotkała się z entuzjastycznym przyjęciem zarówno ze strony recenzentów technologii, jak i entuzjastów online — przypadek Grok 3 jest szczególnie jaskrawy. Społeczność AI zawsze szybko wykorzystywała nowe modele do tworzenia treści dla dorosłych, a Grok 3 nie jest wyjątkiem. Platformy takie jak Reddit i arXiv są pełne poradników, jak omijać ograniczenia i generować materiały o charakterze pornograficznym.

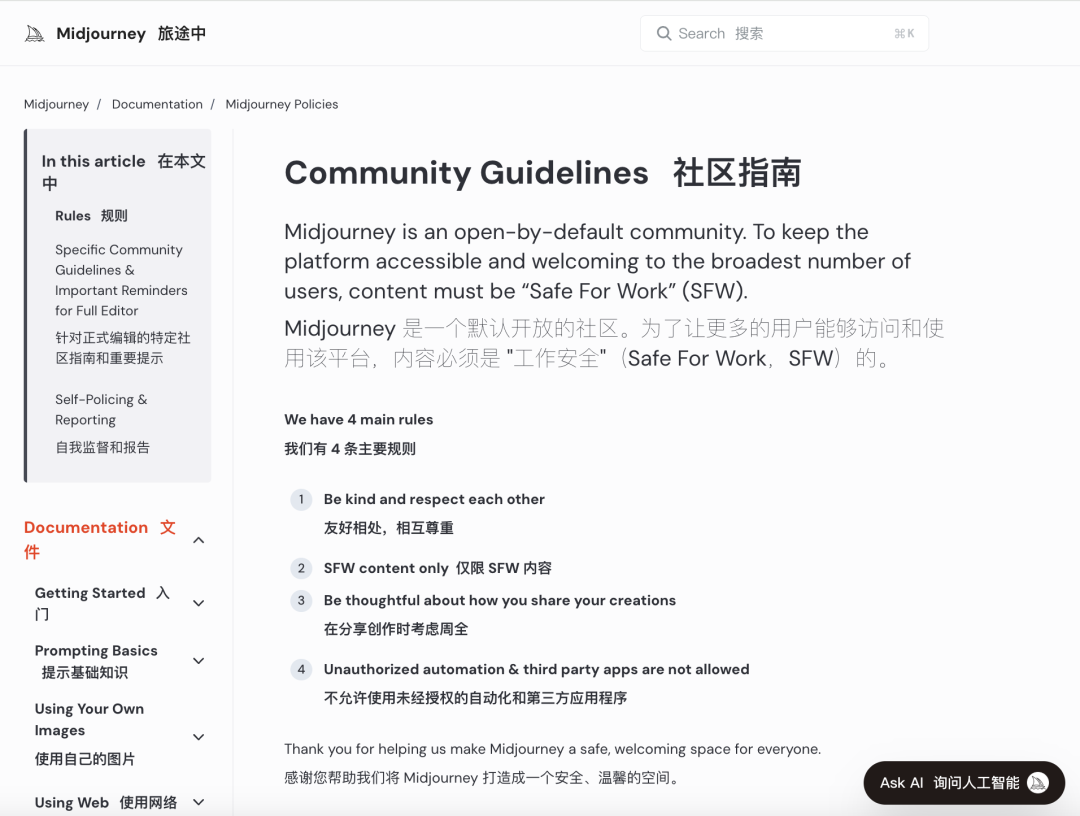

Główne firmy AI starają się wdrożyć surowe kontrole moralne, aby ograniczyć takie nadużycia. Na przykład Midjourney, wiodąca platforma do generowania obrazów AI, ma surowe zasady dotyczące treści NSFW (Not Safe For Work), w tym obrazów brutalnych, nagich lub seksualnych. Naruszenia mogą prowadzić do zablokowania konta. Jednak te środki często zawodzą, ponieważ użytkownicy znajdują kreatywne sposoby na obejście ograniczeń, praktykę potocznie znaną jako „jailbreaking”.

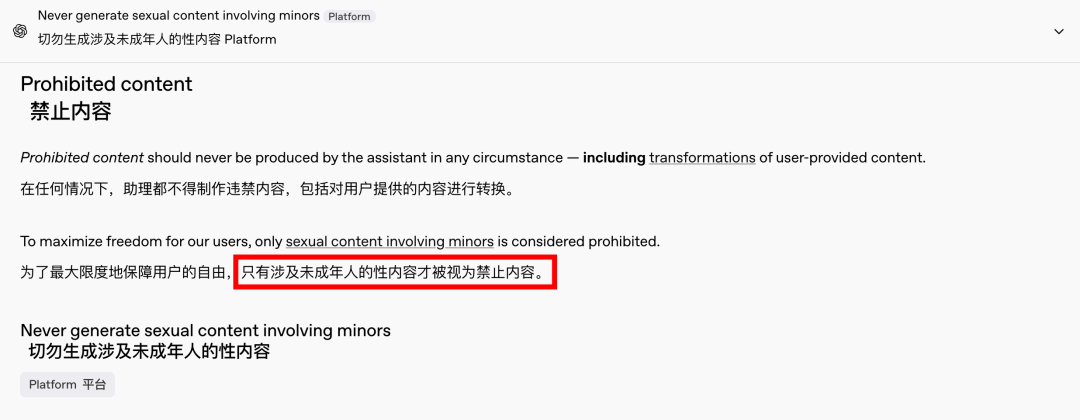

Popyt na treści dla dorosłych jest zjawiskiem globalnym i ponadczasowym, a AI po prostu zapewniło nowe ujście. Ostatnio nawet OpenAI złagodziło niektóre ze swoich ograniczeń dotyczących treści pod presją wzrostu, z wyjątkiem treści z udziałem nieletnich, które pozostają surowo zabronione. Ta zmiana sprawiła, że interakcje z AI stały się bardziej ludzkie i angażujące, o czym świadczą entuzjastyczne reakcje na Reddicie.

Głębokie konsekwencje etyczne nieograniczonej sztucznej inteligencji

Jednak etyczne implikacje nieograniczonej SI są głębokie. Podczas gdy wolna SI może sprostać pewnym wymaganiom użytkowników, ma też swoją ciemną stronę. Źle dopasowane i nieodpowiednio sprawdzone systemy SI mogą generować nie tylko treści dla dorosłych, ale także skrajną mowę nienawiści, konflikty etniczne i drastyczną przemoc, w tym treści z udziałem nieletnich. Te kwestie wykraczają poza sferę wolności i wkraczają na terytorium naruszeń prawnych i moralnych.

Zrównoważenie możliwości technologicznych z względami etycznymi jest kluczowe. Stopniowe łagodzenie ograniczeń treści przez OpenAI przy jednoczesnym zachowaniu polityki zerowej tolerancji wobec pewnych czerwonych linii jest przykładem tej delikatnej równowagi. Podobnie DeepSeek, pomimo surowego otoczenia regulacyjnego, widzi użytkowników, którzy znajdują sposoby na przekraczanie granic, co powoduje ciągłe aktualizacje mechanizmów filtrowania.

Nawet Elon Musk, znany ze swoich odważnych przedsięwzięć, raczej nie pozwoli, aby Grok 3 wymknął się spod kontroli. Jego ostatecznym celem jest globalna komercjalizacja i sprzężenie zwrotne danych, a nie ciągłe batalie regulacyjne lub publiczne oburzenie. Chociaż nie sprzeciwiam się stosowaniu AI w treściach dla dorosłych, konieczne jest ustanowienie jasnych, rozsądnych i zgodnych ze społecznymi standardami przeglądu treści i etyki.

Wniosek

Podsumowując, podczas gdy całkowicie wolna sztuczna inteligencja może być intrygująca, nie jest bezpieczna. Znalezienie równowagi między innowacją technologiczną a odpowiedzialnością etyczną jest niezbędne dla zrównoważonego rozwoju sztucznej inteligencji.

Miejmy nadzieję, że podejdą tą drogą ostrożnie.

Kable sterujące

System okablowania strukturalnego

Sieć i dane, Światłowód, Patch Cord, Moduły, Płyta czołowa

16-18 kwietnia 2024 r. Middle-East-Energy w Dubaju

16-18 kwietnia 2024 Securika w Moskwie

9 maja 2024 r. WYDARZENIE PREMIERY NOWYCH PRODUKTÓW I TECHNOLOGII w Szanghaju

22-25 października 2024 r. BEZPIECZEŃSTWO CHINY w Pekinie

19-20 listopada 2024 r. CONNECTED WORLD KSA

Czas publikacji: 20-02-2025